Page 56 - 《应用声学》2022年第3期

P. 56

378 2022 年 5 月

由图 4 可以看出,在 TSCNN-CL 训练过程中, 这并不意味着早期层输出的特征图已经达到了最

在迭代 10 Epoch 之前训练集和验证集的损失值从 好的效果,而只是达到了一个局部最优。换言之,

0.14 迅速下降,在 10 Epoch 和 30 Epoch 之间损失 整体网络的性能由于早期层的卷积核没有得到充

函数缓慢下降,40 Epoch 之后的损失值逐渐趋于 分的训练,而导致最终的分类效果没有得到提升。

平稳,且稳定在 0.015。由于采用的验证集数据样 TSCNN-CL 则通过对早期的卷积层添加协同分支,

本和训练集样本不同,两个模型在验证时损失值在 使其继续进行训练,从而提高了其输出的特征图质

20 Epoch 左右存在震荡。此外,在与 TSCNN 的比 量,因此增强了网络的分类性能。

较中可以看出,TSCNN-CL的损失函数曲线变化更

加平滑,收敛更加迅速。 表 1 不同分支之间的实验结果比较

4.4 单分支与多分支比较 Table 1 Comparison of experimental re-

sults among different branches

为验证多分支协同学习的有效性,本文分别在

(单位: %)

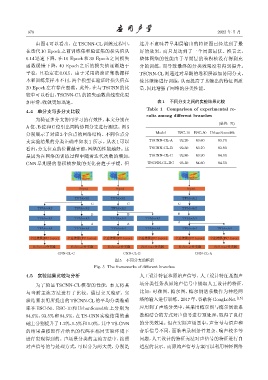

A位、B位和 C 位引出同构协同分支进行测试。图 5

分别展示了对应 3 个位点的网络结构。不同位点分 Model ESC-10 ESC-50 UrbanSound8k

支实验结果的分类正确率如表 1 所示。从表 1 可以 TSCNN-CL-A 92.20 83.60 83.70

看出,分支位点的位置越靠前,网络的性能越好。这 TSCNN-CL-B 92.30 83.70 83.80

是因为在网络的训练过程中随着迭代次数的增加, TSCNN-CL-C 92.80 83.90 84.00

CNN 早期层的卷积核参数的变化会趋于平缓。但 TSCNN-CL-BC 93.50 84.60 84.50

Input Input Input

TFblock1 TFblock1 TFblock1

C C C

TFblock2 TFblock2 TFblock2 TFblock2

B B B

TFblock3 TFblock3 TFblock3 TFblock3 TFblock3

A

A A

TFblock4 TFblock4 TFblock4 TFblock4 TFblock4 TFblock4

Лᤌଌࡏ(FC layer) Лᤌଌࡏ(FC layer) Лᤌଌࡏ(FC layer) Лᤌଌࡏ(FC layer) Лᤌଌࡏ(FC layer) Лᤌଌࡏ(FC layer)

SoftmaxѬዝ٨ SoftmaxѬዝ٨ SoftmaxѬዝ٨ SoftmaxѬዝ٨ SoftmaxѬዝ٨ SoftmaxѬዝ٨

CNN-CL-C CNN-CL-B CNN-CL-A

图 5 不同分支的框架

Fig. 5 The frameworks of different branches

4.5 实验结果比较与分析 人工设计特征和原始声信号。人工设计特征是指声

为了验证 TSCNN-CL 模型的性能,本文将其 场分类任务从原始声信号中提取人工设计的特征,

与当前主流方法进行了比较。通过交叉验证,实 比如:时频图、梅尔图、梅尔倒谱系数作为神经网

验结果表明所提出的 TSCNN-CL 的平均分类准确 络的输入进行训练。2017年,谷歌将GoogLeNet [15]

率在 ESC-50、ESC-10 和 UrbanSound8k 上分别为 应用到了声场分类中,其采用梅尔图与梅尔倒谱系

84.6%、93.5% 和 84.5%,在 TS-CNN 实验结果的基 数相结合的方式对声信号进行预处理,取得了良好

础上分别提升了1.2%、1.5%和1.0%。其中TS-CNN 的分类效果。但在实际声场景中,声信号与语声和

的结果是按照作者给出的代码在相同实验环境下 音乐信号不同,面临着录制条件复杂、噪声较多等

进行复现得到的。声场景分类的主流方法中,按照 问题,人工设计的特征无法对声信号的特征进行自

对声信号的与处理方式,可以分为两大类,分别是 适应的表示。而原始声信号方案可以利用神经网络