Page 154 - 《应用声学》2023年第4期

P. 154

816 2023 年 7 月

阶段将所有输入数据压缩为一个固定长度的语义 了 ISBI 2015 细胞追踪挑战赛和龋齿检测挑战赛的

编码向量。这是一个有损压缩,过程中会产生信息 冠军。U-Net是一种典型的编解码结构,编码层和解

丢失的问题,随着序列长度的增加,深层的特征会 码层相互对称,结构类似于 “U” 型而得名。在恢复

不断覆盖浅层的特征,信息丢失会更加严重,解码 丢失的高频成分与预测结果时,与高频成分相关程

阶段的质量自然会受到影响。且语声信号作为一种 度大的输入数据,应分配更大的权重。为了使模型

时序信号,上下文内容间存在关联性,U-Net采用多 能定位重要信息,区分相关与不相关信息,在U-Net

层卷积与反卷积结构,无法关注到语声序列中时频 的跳跃连接中引入了 Attention 机制,将输入数据

结构的关联信息。因此需要一种能够关注全局关联 有选择性地传入解码层,以达到更好地恢复丢失高

信息的结构来提升 U-Net 模型对于骨导语声增强 频成分的目的。

的性能。据此,本文在 U-Net 的跳跃连接中引入了

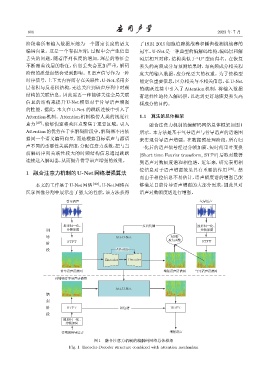

Attention 机制。Attention 机制模仿人类的视觉注 1.1 算法的总体框架

意力 [27] ,能够快速将关注点聚焦于重要区域。引入 融合注意力机制的编解码网络总体框架如图 1

Attention的优势在于在解码阶段中,解码器不再依 所示。本方法是基于气导语声与骨导语声的语谱图

据同一个语义编码向量,而是根据目标语声与源语 来实现骨导语声增强。在数据预处理阶段,所有归

声不同的重要性关联程度,分配注意力系数,把与当 一化后的语声信号经过分帧加窗、短时傅里叶变换

前解码序列关联性较大的时频结构信息通过跳跃 (Short time Fourier transform, STFT)后取对数得

连接送入解码器,从而提升骨导语声增强的效果。 到语声对数幅度谱和相位谱。近年来,研究表明相

位信息对于语声增强效果具有重要的作用 [28] 。然

1 融合注意力机制的U-Net网络增强算法

而由于相位信息不易估计,语声幅度谱的增强已能

本文的工作基于 U-Net 网络 [22] ,U-Net 网络在 够满足目前骨导语声增强的大部分需求,因此只对

医学图像分割中展示出了强大的性能,该方法获得 语声对数幅度谱进行增强。

ᰤឦܦ ඡឦܦ

ฉॎॆʷӑnj ԦՔ͜୧ ฉॎॆʷӑnj

ᝫ Ѭࣝҫቔ Ѭࣝҫቔ

ጷ Att-U-Net ૯ܿѦ

MSE

STFT STFT

Att-skip

Encoder Decoder

ᰤឦܦឦ៨ڏ ܙूឦܦឦ៨ڏ ඡឦܦឦ៨ڏ

ॠܙूᰤឦܦឦ៨ڏ

Att-U-Net

ܙ

ू

STFT ᄱͯ៨ ISTFT

ฉॎॆʷӑnj

Ѭࣝҫቔ

ॠܙूᰤឦܦ ܙूឦܦ

图 1 融合注意力机制的编解码网络总体框架

Fig. 1 Encoder-Decoder structure combined with attention mechanism