Page 32 - 《应用声学》2023年第1期

P. 32

28 2023 年 1 月

现有的合成语声检测系统大多模型结构复杂 LFCC、CQCC 和修正群延时 (Modified group de-

且参数量较大。本文提出了一种基于 Transformer lay, MGD) 特征,均为经过分帧将语声信号近似为

编码器模型的合成语声检测方法,利用自注意力 平稳信号后计算得到的帧级别特征。基于时序的帧

机制,学习输入信号声学特征内部的相关性和长 级别特征可以使得 Transformer 编码器更好地学习

期依赖关系。相比于原始的 Transformer 编码器模 到特征内部的长期依赖关系。ASVspoof2019-LA数

型 [18] ,适当地减少了编码器层数与注意力操作次 据集中语声数据的采样率为f s = 16 kHz。

数,模型结构简单,参数量较小,实验结果表明本文 对数功率谱是对输入语声分帧加窗后,进行

所提出的模型在 ASVspoof2019 数据集上取得了比 512 点傅里叶变换,并计算功率谱,然后对功率谱

大部分现有模型更优的性能。 进行对数尺度变换得到的 [9] 。所采用的是窗长为

25 ms,帧移为10 ms的汉宁窗,如式(1)所示:

1 合成语声检测系统结构 ( )

S spec (t, ω) = 20 lg |X(t, ω)| , (1)

2 × 10 −5

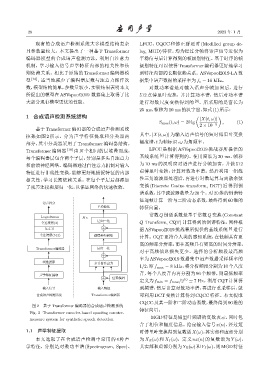

基于 Transformer 编码器的合成语声检测系统

其中,|X(t, ω)| 为输入语声信号的短时傅里叶变换

框架如图 2 所示,分为声学特征提取和分类器两

部分,其中分类器采用了 Transformer 编码器结构。 幅度谱,t为帧标识,ω 为角频率。

Transformer 编码器 [18] 由 N 个相同的层堆叠而成, LFCC 是根据 ASVspoof2019 挑战赛所提供的

每个编码器层包含两个子层,分别是多头自注意力 基线系统 [8] 计算得到的。使用窗长为 20 ms、帧移

和前馈神经网络。编码器通过自注意力机制对输入 为 10 ms 的汉明窗对语声进行分帧加窗,并做 512

特征进行非线性变换,能够更好地捕捉特征的内部 点傅里叶变换,计算对数功率谱。然后利用一组线

相关性,学习长期依赖关系。在每个子层后都添加 性三角滤波器处理后,再进行对数运算与离散余弦

了残差连接和层归一化,以保证网络的快速收敛。 变换 (Discrete Cosine transform, DCT) 后得到倒

谱系数,其中滤波器数量为20个。对20维的倒谱特

征逐帧计算一阶与二阶动态系数,最终得到 60维的

ឦܦ४Ѭ

ࣱکӑ 特征向量。

常数 Q 倒谱系数是基于常数 Q 变换 (Constant

Logsoftmax NT

ࡏॆʷӑ

Лᤌଌࡏ(2) Q Transform, CQT) 计算得到的倒谱特征,同样根

ReLU 据 ASVspoof2019 挑战赛所提供的基线系统 [8] 进行

Лᤌଌࡏ(512) ҒᯠᇸፃᎪፏ 计算。CQT 更符合人类的感知系统,在低频具有更

高的频率分辨率,而在高频具有更高的时间分辨率,

Transformerᎄᆊ٨ ࡏॆʷӑ

对于高频信息损失更少。选择的分析频段最高频

率为 ASVspoof2019 数据集中语声数据采样频率的

ጳভઆॖ ܳ݀ᒭฌਓҧ

1/2,即f max = 8 kHz,将分析频段分割为 10个八度

音,每个八度音内再分割为 96 个频带,则最低频率

ܦߦྲढ़ଢԩ

ͯᎶᎄᆊ 10

定义为f min = f max /2 ≃ 7 Hz。利用CQT计算得

ᣥКηՂ ᣥКྲढ़ 到频谱,然后计算对数功率谱,再进行重采样后,就

Ռੇឦܦೝጇፒ Transformerᎄᆊ٨ 可利用 DCT 变换计算得到 CQCC 特征。本文提取

CQCC及其一阶和二阶动态系数,最终得到90维的

图 2 基于 Transformer 编码器的合成语声检测系统

特征向量。

Fig. 2 Transformer encoder-based spoofing counter-

MGD 特征是傅里叶频谱的复数表示,同时包

measure system for synthetic speech detection

含了相位和幅度信息。给定输入信号 x(n),经过短

1.1 声学特征提取 时傅里叶变换得到复数谱X(ω),其实部和虚部分别

本文选取了在合成语声检测中常用的 4 种声 为 X R (ω) 和 X I (ω),定义 nx(n) 的复数谱为 Y (ω),

学特征,分别是对数功率谱 (Spectrogram, Spec)、 其实部和虚部分别为Y R (ω)和Y I (ω),则MGD 特征