Page 202 - 《应用声学)》2023年第5期

P. 202

1094 2023 年 9 月

h t 表示当前节点输出的隐藏状态,由输出门o t 和当 1 × 1 × C 的 C 维向量,以表征网络中间层的全局

前细胞状态计算得到,使用 tanh 函数作为激活函 信息。第二步的 Excitation 操作对全局平均池化后

数,其计算如下: 生成的 z c 依次进行了全连接、ReLU 激活、全连接、

h t = o t × tanh(C t ). (9) Sigmoid 激活,得到代表各通道重要性的权重矩阵,

其表达式为

h t h t

s = F ex (z c , W) = σ (g (z c , W))

f + = σ (W 2 δ (W 1 z c )) , (11)

C t֓ C t

tanh

其中,δ 为线性激活函数,W 1 与 W 2 为两个全连接

f f

f

层,σ 为Sigmoid激活函数。

σ σ tanh σ

将 Excitation 操作后求得的权重矩阵 s 与前端

h t֓

h t

网络中间层矩阵相乘可得到FDF矩阵,从而实现由

多通道的联合深度特征 (Joint deep feature, JDF)

X t

向FDF的转变。

图 3 单个 LSTM 节点的内部结构

Fig. 3 Internal structure of LSTM node Лࡍࣱ Лᤌଌ ReLU Лᤌଌ Sigmoid

کӑ

将 LSTM 网络层输出的全部隐藏状态 H 使用 TTC TTC⊳r TTC⊳r TTC⊳r TTC⊳r

Flatten 层降维后输入到节点数分别为 1024 和 256

的全连接层进行特征整合,激活函数为 ReLU 函

数,全连接层后使用了Dropout 函数以抑制过拟合, JDF f FDF

Dropout 率为 0.3,并由 6 个节点的 Softmax 分类层 HTWTC HTWTC

得到情感分类结果。将SCNC特征输入LSTM以训

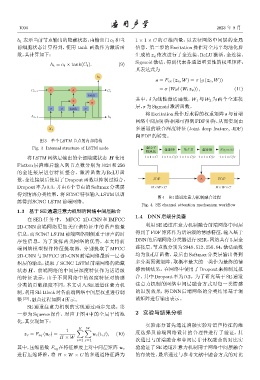

图 4 SE 通道注意力机制融合过程

练得到SCNC LSTM 前端网络。

Fig. 4 SE channel attention mechanism workflow

1.3 基于SE通道注意力机制的网络中间层融合

1.4 DNN后端分类器

在 SER 任 务 中, MFCC 2D-CNN 和 IMFCC

2D-CNN 前端网络更加关注谱特征中的语声能量 利用 SE 通道注意力机制融合前端网络中间层

信息,而SCNC LSTM 前端网络则侧重于语声的时 得到了 FDF矩阵作为话语级的情感特征,输入基于

序性信息。为了发挥两类网络的优势,本文将前 DNN的后端网络分类器进行SER,网络共有 5 层全

端网络模型视作特征提取器,分别提取了 MFCC 连接层,节点数分别为 2048、512、256、64,激活函数

2D-CNN 与 IMFCC 2D-CNN 前端网络最后一层卷 均为 ReLU 函数,最后由 Softmax 分类层输出得到

积层的输出,提取了 SCNC LSTM 前端网络的隐藏 多分类预测矩阵,取概率最大的一类作为最终的情

状态 H。前端网络的中间层深度特征作为话语级 感预测结果。在网络中使用了 Dropout 来抑制过拟

的特征表示,由于不同网络中的深度特征对情感 合,其中 Dropout 率为 0.2。为了研究基于 SE 通道

分类的贡献程度不同,本文引入 SE 通道注意力机 注意力机制的网络中间层融合方式对每一类情感

制,利用 SE Block对各前端网络中间层权重进行调 的识别效果,将 DNN 后端网络的分类结果基于混

整 [23] ,融合过程如图4所示。 淆矩阵进行输出表示。

SE 通道注意力机制的实现通过两步完成。第

一步为 Squeeze 操作,对应于图 4 中的全局平均池 2 实验与结果分析

化,其实现如下:

实验部分首先通过消融实验对语声特征的维

H W

1 ∑ ∑ 度选择及前端网络设计的合理性进行了验证,其

z c = F sq (u c ) = u c (i, j), (10)

H × W

i=1 j=1 次通过与前端融合和中间层非计权融合的对比实

验验证了 SE 通道注意力机制用于网络中间层融合

其中,压缩函数 F sq 在特征维度上对中间层矩阵 u c

进行压缩降维,将 H × W × C 的多通道特征降为 的有效性,最后通过与参考文献中融合方式的对比