Page 93 - 201903

P. 93

第 38 卷 第 3 期 李云红等: 一种改进的 DNN-HMM 的语音识别方法 375

(3)网络参数设定 进一步实验分析,比较滤波器组数目对实验结果的

整个深度神经网络模型包含 1 个输入层、4 个 影响。

隐藏层和 1 个输出层,网络输入选择超长帧 (连续 一个音素的发音时间一般在 9 帧左右,拼接特

11 帧组成),隐藏层共有 1024 个节点,输出层共有 征的选择在 9 帧以上。实验中,拼接特征选择 11帧,

1366 个节点,各节点关联各种音素标签,输出层用 左右各5帧。根据Fbank特征滤波器组数目的不同,

Softmax网络作分类。 输入层节点个数分别设置为 88、209、330、451、572、

另外,由于深度神经网络模型参数调谐过程中 770、891。经训练误差的比较后,4 个隐藏层节点

需要根据开发集和测试集识别率的对比控制迭代 个数选择 1024。输出层1366 个节点,关联各种音素

次数。故在训练集中选取 3000 条语句作为开发集, 标签。

选择1000条语句构成测试集。 MFCC 特征下 GMM-HMM、DNN-HMM 和改

(4)网络训练 进的 DNN-HMM 声学模型的句错误率与词错误率

首先初始化参数,设置 RBM 模型迭代 20 次。 如表 2 所示。改进的 DNN-HMM 声学模型在不同

设置最小交叉熵为目标函数,借此调整参数。通过 Fbank 特征下的句错误率和词错误率如表 3 所示,

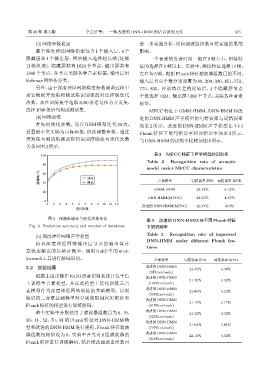

开发集与测试集测试得到识别准确率与迭代次数 与DNN-HMM的识别率比较如图4所示。

关系如图3所示。

表 2 MFCC 特征下声学模型的识别率

100

Table 2 Recognition rate of acoustic

80

model under MFCC characteristics

юᆸဋ/% 60 ᝫጷ 声学模型 句错误率 SER 词错误率 WER

ត

40

GMM-HMM 28.48% 6.13%

20

DNN-HMM(MFCC) 23.63% 4.35%

0

1 2 3 4 5 6 7 8 9 10 11 12

改进的 DNN-HMM(MFCC) 22.37% 415%

ᤖ̽

图 3 预测准确率与迭代次数变化

表 3 改进的 DNN-HMM 在不同 Fbank 特征

Fig. 3 Prediction accuracy and number of iterations 下的识别率

(5)深度神经网络声学模型 Table 3 Recognition rate of improved

DNN-HMM under different Fbank fea-

结合深度神经网络输出层节点的输出值计

tures

算状态输出的后验证概率,调用 Kaldi 中的 nnet-

forward工具进行解码识别。 声学模型 句错误率 SER 词错误率 WER

3.2 实验结果 改进的 DNN-HMM 21.35% 3.38%

(8Filter-bank)

根据上述步骤在 Kaldi语音识别系统开发平台 改进的 DNN-HMM

21.26% 3.23%

上训练单音素模型,并在此模型上优化训练三音 (19Filter-bank)

素模型作为深度神经网络训练的基础模型。以训 改进的 DNN-HMM 21.06% 3.12%

(30Filter-bank)

练好的三音素基础模型对分别使用 MFCC 特征和 改进的 DNN-HMM

Fbank特征的模型进行训练解码。 (41Filter-bank) 21.14% 3.17%

整个实验中分别使用了滤波器组数目为 8、19、 改进的 DNN-HMM 21.32% 3.32%

(52Filter-bank)

30、41、52、70、81 的 Fbank 特征对 DNN-HMM 模

改进的 DNN-HMM

型和改进的DNN-HMM进行建模,Fbank特征滤波 (70Filter-bank) 21.64% 3.61%

器组数初始值设为 8,实验中首先对 8 组滤波器的 改进的 DNN-HMM 22.14% 4.02%

(81Filter-bank)

Fbank 特征进行训练解码,然后修改滤波器组数目