Page 172 - 《应用声学》2022年第5期

P. 172

848 2022 年 9 月

形成了时空注意力机制,集合了两者的优点,无论是 被识别成 neutral 情感;在 Emo-DB 库中识别率为

串行结构还是并行结构均使得模型的性能得到了 68%,有 20% 的 happy 被识别成愤怒。上述分析结

显著改善。串行的 STA-CRNN 模型相较于并行的 果与之前的研究结果一致 [28−29] ,由于训练数据的

STA-CRNN 模型,在两个数据库上均取得了最好 有限性以及 happy 类别比其他类别更依赖语境,导

的结果,在Emo-DB库中WA和UA分别高了0.2%、 致happy类别很难被识别。

0.8%,在 IEMOCAP 中分别高了 1.3%、1.1%,并且 2.4 与现有SER实验结果对比

其收敛曲线也最为稳定。

本文选择以下 8 种网络作为对比实验:基于三

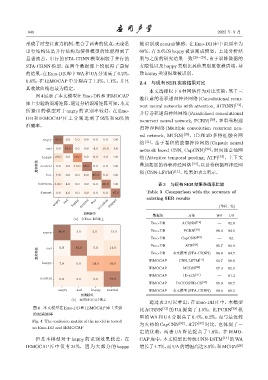

图4展示了本文模型在Emo-DB和IEMOCAP

维注意的卷积递归神经网络 (Convolutional recur-

库上实验的混淆矩阵,通过分析混淆矩阵可知,本文 [12]

rent neural networks with attention, ACRNN) ,

所提出的模型对于 angry 的识别率较好,在 Emo-

并行卷积递归神经网络 (Parallelized convolutional

DB 和 IEMOCAP 库上分别达到了 95% 和 80% 的

recurrent neural network, PCRN) [30] ,多重卷积递

准确率。

归神经网络 (Multiple convolution recurrent neu-

ral network, MCRN) [28] ,1D 和 3D 多特征融合网

angry 95.0 0.0 5.0 0.0 0.0 0.0 0.0

络 [31] ,基于卷积的胶囊神经网络 (Capsule neural

sad 0.0 83.0 0.0 0.0 4.0 10.0 3.0 [32]

network based CNN, CapCNN) ,时间注意池网

happy 20.0 0.0 68.0 0.0 8.0 4.0 0.0 络 (Attentive temporal pooling, ATP) [33] ,上下文

ᄾࠄಖኤ neutral 0.0 2.0 10.0 88.0 0.0 0.0 0.0 叠加拓展的卷积神经网络 [34] ,以及卷积循环神经网

fear 7.0 0.0 0.0 6.0 85.0 5.0 0.0 络(CNN-LSTM) [11] 。结果如表3所示。

boredom 10.0 4.0 0.0 0.0 0.0 86.0 0.0 表 3 与现有 SER 结果准确率比较

disgust 0.0 4.0 0.0 3.0 0.0 6.0 87.0 Table 3 Comparison with the accuracy of

existing SER results

angry sad happy neutral fear boredom disgust (单位: %)

ᮕಖኤ

数据集 方法 WA UA

(a)NjښEmo-DBःʽ

Emo-DB ACRNN [12] — 82.8

angry 80.0 5.0 2.0 13.0 Emo-DB PCRN [29] 86.4 84.5

Emo-DB CapCNN [32] — 82.

Emo-DB ATP [33] 85.7 82.9

14.0

0.0

81.0

5.0

sad

ᄾࠄಖኤ Emo-DB 本文模型 (STA-CRNN) 86.8 84.7

happy 7.0 6.0 24.0 63.0 IEMOCAP CNN-LSTM [11] 64.7 56.6

IEMOCAP MCRN [28] 67.3 62.0

IEMOCAP 1D+3D [31] — 61.2

neutral 9.0 9.0 5.0 77.0

IEMOCAP DiCCOSER-CS [34] 65.8 56.7

angry sad happy neutral IEMOCAP 本文模型 (STA-CRNN) 69.4 65.5

ᮕಖኤ

(b)NjښIEMOCAPःʽ

通过表 3 可以看出,在 Emo-DB 库中,本模型

图 4 本文模型在 Emo-DB 和 IEMOCAP 库上实验 比 ACRNN [12] 的 UA 提高了 1.9%;比 PCRN [29] 模

的混淆矩阵

型的 WA 和 UA 分别高了 0.4%、0.2%;而与最近较

Fig. 4 The confusion matrix of the model is tested

为火热的 CapCNN [32] 、ATP [33] 对比,也体现了一

on Emo-DB and IEMOCAP

定的优势,两者 UA 皆是提高了 1.8%。在 IEMO-

但是本模型对于 happy 的识别效果较差:在 CAP 库中,本文模型比传统 CNN-LSTM [11] 的 WA

IEMOCAP 库中仅有 24%,因为大部分的 happy 增长了4.7%,而UA的增幅高达8.9%;和MCRN [28]