Page 94 - 《应用声学》2025年第1期

P. 94

90 2025 年 1 月

提取网络中,采用 CPS(Cross stage partial)、C3 等 确率更高。在YOLOv5s网络中,损失函数由置信度

模块进行特征提取 [22] ,提取后特征通过 SPP (Spa- 损失 (object_loss)、分类损失 (class_loss)、定位损

tial pyramid pooling) 结构整合输入到特征融合网 失 (box_loss) 三部分构成。最初对于回归损失,采

络中;采用特征金字塔网络 [23] (Feature pyramid 用 IoU 来计算损失值,IoU 表示的是预测框与真实

networks) 和金字塔注意力网络 [24] (Path aggrega- 框之间的交并比,计算公式为

tion network)进行特征提取和融合。最后利用损失 |A ∩ B|

函数 [25] 对目标进行回归,并利用二元交叉熵损失 IoU = |A ∪ B| , (1)

函数进行分类和置信度回归。

式(1) 中:A为预测框,B 为真实框,A ∩ B 代表预测

1.2 引入注意力机制 框与真实框相交的面积,A ∪ B 代表预测框与真实

为了选择性地加强图像信息的特征,抑制无用 框相并的面积。

的特征,减少特征信息丢失,本文引入注意力机制 但当预测框与真实框不重叠时,根据公式 (1)

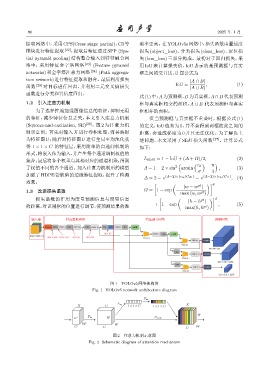

(Squeeze-and-excitation, SE) [26] ,图 2 为注意力机 的定义,IoU 值将为 0,并不会得到两框彼此之间的

制示意图。首先对输入 X 进行卷积处理,将其映射 距离,会造成梯度为 0 并且无法优化。为了解决上

为特征图 U;随后对特征图 U 进行全局平均池化获 述问题,本文采用了 SIoU 损失函数 [27] 。计算公式

得 1 × 1 × C 的特征层,采用简单的自选门机制的 如下:

形式,将嵌入作为输入,并产生每个通道调制权值的

集合;最后将各个权重与其相对应的通道相乘,得到 L SIoU = 1 − IoU + (∆ + Ω)/2, (2)

( ( ) π )

了权值不同的各个通道。加入注意力机制后的模型 Λ = 1 − 2 × sin 2 arcsin c h − , (3)

σ 4

加强了 HDPE 管缺陷的边缘特征提取,提升了检测

∆ = 2 − e (Λ−2)×(c w /C W ) − e (Λ−2)×(c h /C H ) , (4)

效果。

[ ( gt )] θ

|w − w |

1.3 改进损失函数 Ω = 1 − exp − gt

max (w, w )

损失函数的作用为度量预测信息与期望信息 [ ( gt )] θ

|h − h |

的距离,对识别框的位置进行调节,使预测结果的准 + 1 − exp − max(h, h ) , (5)

gt

ᣥКቫ ྲढ़ଢԩᎪፏ ྲढ़ᚸՌᎪፏ ᮕᎪፏ

Focus CBL CSP1-1 CBL CSP1-3 CBL CSP1-3 CBL SPP CSP2-1 CBL ʽ᧔ನ

19T19 CSP2-1 CBL ʽ᧔ನ

608T608T3

304T304 152T152 76T76 38T38 Concat

CSP2-1 CONV

Concat

76T76T255

CBL

CSP2-1 CONV

Concat

38T38T255

CBL

CSP2-1 CONV

Concat

19T19T255

图 1 YOLOv5 网络架构图

Fig. 1 YOLOv5 network architecture diagram

F ex

F sq Xϕ

X U 1T1TC 1T1TC

H

F tr H

H ϕ F scale

W ϕ W

C ϕ C C W

图 2 注意力机制示意图

Fig. 2 Schematic diagram of attention mechanism