Page 9 - 《应用声学》2025年第3期

P. 9

第 44 卷 第 3 期 雷菁等: 无人机搜救场景下语声增强技术进展综述 543

无人机场景下基于深度学习的语声增强模型 号的频谱特征进行处理,从而估计目标信号的频

可以分为单通道和多通道两类。单通道的方法主 谱或掩膜。2024 年,Chen 等 [30] 提出了一种频率域

要是将一般场景下主流的单通道语声增强模型应 瓶颈适配器,用于捕获无人机噪声的谐波特性,并

用到无人机场景中。2019 年,Chun 等 [29] 提出了一 通过迁移学习来适应不同类型无人机的噪声。该

种基于深度卷积去噪自编码器的无人机噪声抑制 方法在 FRCRN [31] 的编码器模块中嵌入适配器,通

方法,训练后的模型能够有效减少无人机飞行的 过微调适配器参数来适应不同类型无人机的噪声。

自噪声和风噪。此后,Mukhutdinov 等 [17] 对时频 Premachandra 等 [32] 提出通过 GAN 生成伪无人机

域、复数时频域以及时域的主流单通道增强模型进 噪声,并从混合信号中减去生成的伪无人机噪声,实

行对比研究,发现复数时频域的 UNet 综合性能最 现噪声抑制。在抑制噪声后,使用 U-Net 架构来恢

优,在 SNR = −15 dB 时,增强后的信号语声质量 复目标语声,确保语声的完整性和质量。

感知评估从 1.0 提升到 1.9。由于主流的单通道增强 表 3 列出了上述方法的实验设置信息,其中训

模型通常针对 SNR 在 −5 dB 以上的场景,将这些 练集通过将语声数据集和噪声数据集混合得到,一

模型直接应用到 SNR 极低的无人机场景会出现明 般涵盖了不同 SNR 组合。这些组合的设计旨在模

显的性能下降。因此,研究人员也提出了一些针对 拟不同噪声环境下的实际应用场景,以提升算法在

无人机场景下的语声增强方法。2019年,Tan等 [18] 多种 SNR 条件下的表现。语声数据集合噪声数据

提出 SMoLnet,使用一系列堆叠的卷积块对带噪信 集的时长为训练集中使用的时长。

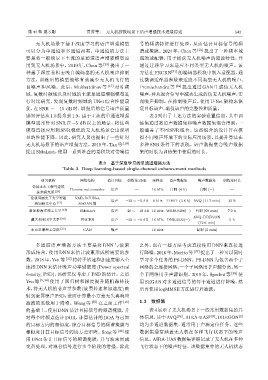

表 3 基于深度学习的单通道增强方法

Table 3 Deep learning-based single-channel enhancement methods

研究机构 网络结构 估计目标 训练集 SNR 采样率 语声数据集 噪声数据集 训练集时长

韩国土木工程与建筑

Denoise autoencoder 语声 — 16 kHz 自制 (4 h) 自制 (−) —

技术研究所 [29]

伦敦玛丽女王大学智能 VAE,DCUNet,

语声 −25 ∼ −5 dB 8 kHz TIMIT (3.8 h) AVQ (11.7 min) 35 h

感知研究中心 [17] SEGAN 等

新加坡南洋理工大学 [18] SMoLnet 语声 −20 ∼ −10 dB 16 kHz WSJ0-SI84(−) 自制 (68 min) 7.9 h

AVQ,DREGON

澳大利亚国立大学 [30] FRCRN 语声 −25 ∼ −5 dB 16 kHz DNS-2022(−) 5 h

(12.6 min)

东京芝浦理工学院 [32] GAN 噪声 — 16 kHz — 自制 (5 min) —

多通道语声增强方法主要是将 DNN 与波束 之外,也有一些方法考虑直接使用 DNN 来直接进

形成结合,使用 DNN 来估计波束形成所需要的参 行降噪。2016年,Morito等 [37] 提出了一种可以同时

数。2018年,Yen等 [33] 将转子转速和加速度输入全 学习多个任务的 PS-DNN。PS-DNN 为包含两个子

连接 DNN 来估计噪声功率谱密度 (Power spectral 网络的全连接网络,一个子网络用于声源分离,另一

density, PSD),该研究仅考虑了 PSD 的估计。之后 个子网络用于声源识别。2019 年,Spadini 等 [38] 使

Yen 等 [5,34] 使用了回归树和梯度提升随机森林技 用 SEGAN 对多通道信号的每个通道进行降噪,然

术,将无人机的非声学参数 (旋翼转速和加速度) 映 后再使用logMMSE方法进行后滤波。

射到旋翼噪声 PSD,进而计算最小方差无失真响应

滤波的系数用于降噪。Wang 等 [35] 在之前工作 [15] 1.3 数据集

的基础上,使用 DNN 估计目标信号的频谱掩膜,并 表4展示了无人机场景下一些常用数据集的具

对每个时频点估计 DOA,计算估计的 DOA 与已知 体信息,其中 AVQ [39] 、AIRA-UAS [40] 、DREGON [3]

的目标方向的相似度,综合目标信号的频谱掩膜与 均为多通道数据集,通常用于声源定位任务。这些

相似度计算目标信号的协方差矩阵。Song 等 [36] 使 数据集通常涵盖无人机在多种飞行状态下的噪声

用 UNet 估计目标信号的频谱掩膜,并与波束形成 信息。AIRA-UAS数据集详细记录了无人机在多种

交替处理,对混合信号进行多个阶段的增强。除此 飞行状态下的噪声特征。该数据集中的无人机状态