Page 143 - 《应用声学》2021年第3期

P. 143

第 40 卷 第 3 期 谭笑枫等: 基于一维卷积神经网络的化爆和地震次声分类 461

85%以上的信息,即q 需要满足 导过程严谨及通用性好的优点,是深度学习算法的

q / l 基础。

∑ ∑

用 BP 神经网络对次声信号进行分类识别,需

λ b λ b > 85%. (8)

b=1 b=1

要确定输入层、输出层和隐藏层节点数。输入层节

(4) 计算奇异谱熵:

点数 I 为输入信号特征的长度,输出层节点数 O 为

m

∑

E j = − p jb lgp jb , (9) 数据类别数,本文为实现地震和化爆分类识别,即

b=1 输出节点数为 2,隐藏层节点数根据经验公式 (10)

/ q

∑ 确定:

λ jb 表示在第 j 个IMF 分量的

其中,p jb = λ jb

√

b=1 (10)

第b个奇异值占全部奇异值的比重。 node = I + O + T,

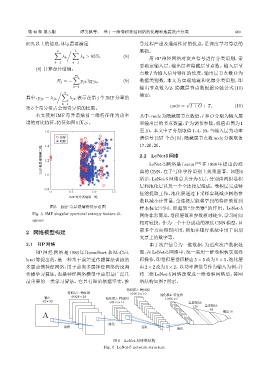

本文使用 IMF 奇异谱熵前二维特征作为功率 其中,node为隐藏层节点数量,I 和O 分别为输入层

谱的对比特征,特征如图5所示。 和输出层的节点数量,T 为调节参数,取值范围为 1

至10。本文中 T 分别取值 1、4、10,当输入层为功率

1.6

ӑྐ 谱信号 (257 个点) 时,隐藏层节点数 node 分别取值

ڡ

17、20、26。

1.4

IMF݉प៨྅ኄ̄፥ 1.2 2.2 LeNet-5 网络是 Lecun [22] 在 1998 年提出的经

LeNet5网络

典的 CNN,在手写体字符识别上效果显著。如图 6

1.0

所示,LeNet-5 网络总共分为 5 层,分别由两组卷积

层和池化层以及一个全连接层组成。卷积层完成特

0.8

0 0.5 1.0 1.5

征的提取工作,池化层通过下采样实现减少网络参

IMF݉प៨྅ኄʷ፥

数以减小计算量,全连接层能将学到的特征映射到

图 5 IMF 奇异谱熵特征示意图 样本标记空间,即起到 “分类器” 的作用。LeNet-5

Fig. 5 IMF singular spectural entropy feature di-

网络非常简单,卷积层数和参数相对较少,学习时间

agram

相对较快。作为一个十分成功的深度CNN模型,目

2 网络模型构建 前多个方面得到应用,例如在银行系统中用于识别

支票上的数字等。

2.1 BP网络 由于次声信号为一维数据,为适应次声数据处

BP 神经网络是 1986 年 Rumelhart 和 McClel- 理,在LeNet-5网络中,统一采用一维卷积核实现卷

land 等提出的,是一种基于误差逆传播算法训练的 积操作,即卷积层卷积核由5 × 5 改为1 × 5,池化层

多层前馈神经网络,用于前向多层神经网络的反向 由2 × 2改为1 × 2。以功率谱信号作为输入为例,并

传播学习算法,也是神经网络模型中应用最广泛且 将二维 LeNet-5 网络改变成一维卷积网络后,其网

最重要的一类学习算法。它具有理论依据坚实、推 络结构如图7所示。

Ԅሥ3: ྲढ़ڏ

Ԅሥࡏ1: ྲढ़ڏ 16@10f10 ӑࡏ4: ྲढ़ڏ

ᣥК 6@28f28 ӑࡏ2: ྲढ़ڏ 16@5f5

32f32

6@14f14 Лᤌଌࡏ:

120 Лᤌଌࡏ:

84

ᣥѣ10

A

ӑ

Ԅሥ Ԅሥ ӑ

图 6 LeNet-5 网络结构

Fig. 6 LeNet-5 network structure